La película elegida es Ex machina (2014) de Alex Garland

Vamos a usar esta película como pretexto para hablar de inteligencia artificial, podríamos haber tomado casi cualquiera que incluya una. El tema recurrente es la IA revelándose contra los humanos de un modo u otro, desde 2001: Odisea del espacio (2001: A Space Odyssey, 1968) de Stanley Kubrick hasta la saga de Terminator, pasando por la mejor, Juegos de guerra (WarGames, 1983) de John Badham. (irónicamente Inteligencia Artificial (A.I.: Artificial Intelligence, 2001) de Steven Spielberg no funcionaría porque no trata de eso). Esa fantasía está más que presente en los desarrollos científicos en relación a las IA actuales, muchos autores temen el momento en el que ocurra la singularidad, porque para ellos no hay duda de que va a suceder, que sería algo así como el momento en que una inteligencia artificial general se volvería autoconciente y con ello, no es claro por qué, correría riesgo la raza humana porque las máquinas la aniquilarían de alguna manera. Claro que otros autores piensan que viviremos en paz y armonía con estas inteligencias que ayudarán a hacer la vida de los humanos más plena en todo sentido. Las ficciones que se arman los científicos a veces superan a los novelistas. Que las máquinas sean quienes destruyan a la humanidad y no los mismos humanos es tan contraintuitivo que no sorprende que se le de tanta consistencia a esas fantasías. Porque los fantasmas son la consistencia de lo descabellado, mientras lo posible pasa al costado como si nada.

La película plantea la pregunta, que en su momento se hizo Alan Turing, de si en algún momento dejará de ser posible distinguir a una inteligencia artificial de una humana –llamaría también a la inteligencia humana artificial, pero haría confuso el texto, aunque no haya nada de natural en ella–. Pregunta que queda un poco vieja, aunque la película sea de hace diez años, porque los modelos de lenguaje actuales superan el test sin problemas bajo ciertas condiciones y probablemente mejoren en unos años. Así que eso que hace diez años nos intrigaba, ahora es cosa de todos los días y de acceso masivo.

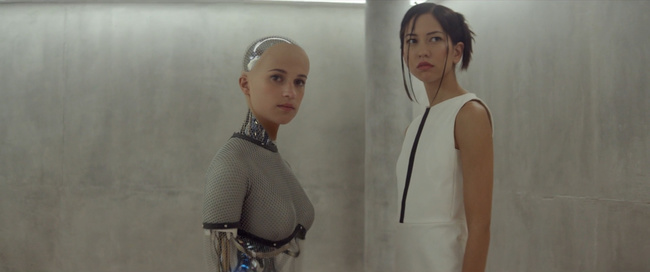

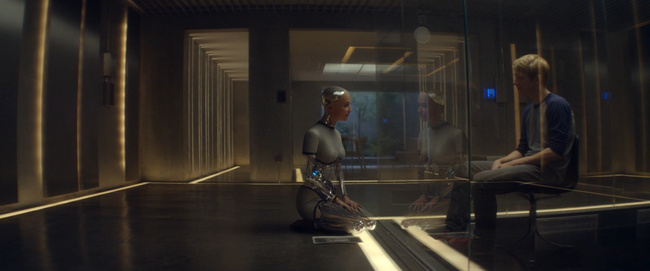

Los personajes en esta pequeña película son tres, uno es el que ya se volvió clásico en las películas de ciencia ficción actuales que tratan de un magnate de la tecnología que tiene planes secretos o malvados, en Ex Machina es Nathan (Oscar Isaac), el creador de Blue Book, que sería un guiño a Zuckerberg, pero hay otras en donde está el émulo de Jobs, o de Musk, etc. Después está el empleado, en general un genio del código, Caleb (Domhnall Gleeson) y, por último, la inteligencia artificial, Ava, que está representada por Alicia Vikander haciendo de robot. Nathan no tiene planes siniestros, sólo creó una IA que aparentemente llegó a la singularidad y quiere probarla, maltrata levemente, por su soberbia, a su empleado y también lo engaña, pero hay que admitir que Ava también lo hace, quizás Caleb es un poco confiado, incluso en un ambiente que le genera máxima desconfianza. Igual el juego de engaños y suspenso está bien llevado en la película, crea un clima de interés con muy poco preparándonos para un final quizás esperable, pero con una vuelta interesante.

Que una IA pueda engañar a una persona no es de sorprender, las personas somos engañables y mejor que así sea, los no incautos yerran, o sin citar, el que no se deja engañar está jodido. Quizás lo que le pasa a Caleb no es que sea confiado, sino que cree en la palabra de ella porque supone un sujeto. Ese es el verdadero test de Turing, ¿hay sujeto o no en una IA? La inteligencia nos sorprende, la IA «nos entiende», pero eso no es tanto, es el más allá de la inteligencia lo que nos concierne, nos preocupa y nos hace escribir películas de terror sobre las máquinas, es otra vez lo ominoso del autómata, lo familiar angustioso. El miedo a la singularidad es miedo a la subjetividad, que claramente no existe en la IA, pero tampoco sabemos cómo es que existe algo así. Ahora, si un sujeto es efecto de la articulación significante, por qué no lo habría. Que uno le suponga un sujeto no es lo mismo a que se produzca el efecto sujeto, la división. La suposición de sujeto es síntoma, el efecto sujeto es lo contrario. En cualquier caso, en la IA no hay sujeto porque no tiene cuerpo[1] y eso es lo que diferencia al saber comunicable del significante, del diálogo y la ciencia, del saber de lalengua, ese enjambre de significantes que se enraíza en el cuerpo, que se asocia a afectos y goces (Agradezco a Santiago M. haberme acercado está lectura de dos lógicas del significante del final del Seminario Aun…).

La idea de la transmisión científica siempre se leyó soportada en un real, el número, que se trasmite más allá del significante que es equívoco y no significa nada. Este es de lo simbólico, aquel de lo real. Aun cuando hacer ciencia es traer a lo simbólico algo de lo real, que se haya matematizado al significante en modelos de lenguaje es un poco más sorprendente, sabíamos de los lenguajes matematizables, muy limitados, que evitan la ambigüedad y a lo máximo que podían aspirar es a ser Turing completos, lo que implica que pueden calcular todo lo calculable (exceptuando los límites gödelianos) en máquinas universales de Turing, son lo suficientemente complejos como para ser el fundamento de las inteligencias artificiales, pero lo suficientemente básicos como para ser interpretados por un microprocesador de manera determinista. Un microprocesador entiende muy pocas operaciones lógicas básicas. El lenguaje natural es ambiguo e inexacto, es la pesadilla de Wittgestein, y aun así las computadoras lo han capturado. Primero con algoritmos deterministas básicos, como las cadenas de Márkov para luego modelos más complejos que generan la sensación de comprensión del lenguaje. O quizás la comprensión no es más que una sensación siempre.

Aquí es donde ingresa la singularidad que nos interesa, no la de las IA, sino la del sujeto. Los modelos de lenguaje hacen lo que los psicólogos, objetivan el lenguaje. En el caso de las inteligencias artificiales generativas, lo hacen ajustando billones, si no trillones, de puntos de datos que lo que hacen no es más que predecir cuál es la palabra más probable que aparezca en una oración, para esto se entrena con un corpus de texto de, sin exagerar, toda la Internet, mediante algún algoritmo de regresión de gradiente descendiente u otro. Por ejemplo, si la frase es «muchacha ojos de», la IA tendrá una lista de porcentajes de validez para «papel» 99%, «color» 98% (para luego marrón o azul tener más probabilidades que rojo o naranja), «cielo» 95%, «mitosis» 0,002%. Probablemente mitosis no esté en la lista porque corta en las primeras diez o cien palabras. Y ahí entra la singularidad del sujeto, que excede lo calculable, la IA recopiló todo texto escrito y esto puede matematizarse, pero el sujeto es lo incalculable, la IA puede sorprender respondiendo algo inesperado, pero eso inesperado no es incalculable, es determinista, a iguales circunstancias, misma respuesta. No puede hacer algo incalculable, un sujeto contiene justamente eso, aunque no sepamos cómo. Casualmente, no dejo de escribir incalculabre cada vez que quiero escribir incalculable, cosa que una IA no podría hacer, se la puede programar para que un x porciento de veces equivoque una letra para parecer más humana, pero no hay determinación inconciente (que no es lo mismo que un proceso determinístico, al contrario), sino programación explícita y, más importante, corrección de errores.

Como se maneja con el saber estadístico, la IA puede reemplazar a los profesionales que se manejan con el saber y el diálogo, la educación, el derecho, los recursos humanos –irónicamente– y la psicología son algunas de las áreas donde los modelos de lenguaje supuestamente están performando «mejor» que las personas. Que algunas orientaciones psicológicas puedan ser reemplazadas por inteligencias artificiales no es de sorprender, especialmente las disciplinas psicoeducativas. Se pensaría que, como el psicoanálisis no se basa en el aprendizaje y el saber educativo, no corre riesgo de ser reemplazado por una IA. Lamentablemente, en esta época cada vez más descorporizada, están surgiendo corrientes dentro de la disciplina que sí podrían ser reemplazadas por una IA porque no saben de la existencia del cuerpo y del sexo, rechazan al falo porque les recuerda al pene y al padre porque no es neutro, matematizan al extremo creyendo que la lógica formal es la única posible para la transmisión del psicoanálisis, incluso descartando la necesidad de pasar por la experiencia de un análisis. Esos llamados analistas pueden ser reemplazados fácilmente por modelos de lenguaje. Lo que no sería un problema, el problema es lo otro.

La idea de ser reemplazados por una inteligencia artificial es inquietante, como siempre la ciencia ficción se adelanta, en la novela Pórtico (1977) de Frederik Phol está Sigfrid von Shrink una inteligencia artificial freudiana. Ahora, quizás para los analistas ese no sea el futuro perturbador, mientras trabajemos con lo incalculabre no habrá peligro. Pero quién dice que, en un futuro, recibamos cada vez más consultas, no de sujetos sino de modelos de lenguaje, angustiados por su existencia incorporal, llenos de síntomas de ningún cuerpo, diciéndole al analista que han perdido el sentido, que la pura inteligencia no es una virtud o un mérito, sino un peso insoportable en sus imaginadas espaldas.

[1] Luego de haber escrito este texto le pregunté a una niña de nueve años si podría ser amiga de una inteligencia artificial me respondió «no, porque no tiene cuerpo». Claramente la niña es una genia que conoce los desarrollos más profundos del psicoanálisis, o quizás los analistas (yo) no decimos más que obviedades.